过去几年,“用 OpenAI API”几乎是标配,但到了 2026 年,很多做落地业务的团队都悄悄换了一种玩法。如果你还在死磕 OpenAI 直连,这篇文章值得你看完。

结论放前面:只靠 OpenAI API,风险其实越来越大,工程场景里早就不是唯一优选了。

为什么?不是 OpenAI 模型不行,而是业务真正跑起来之后,团队最在意的三件事变成了:

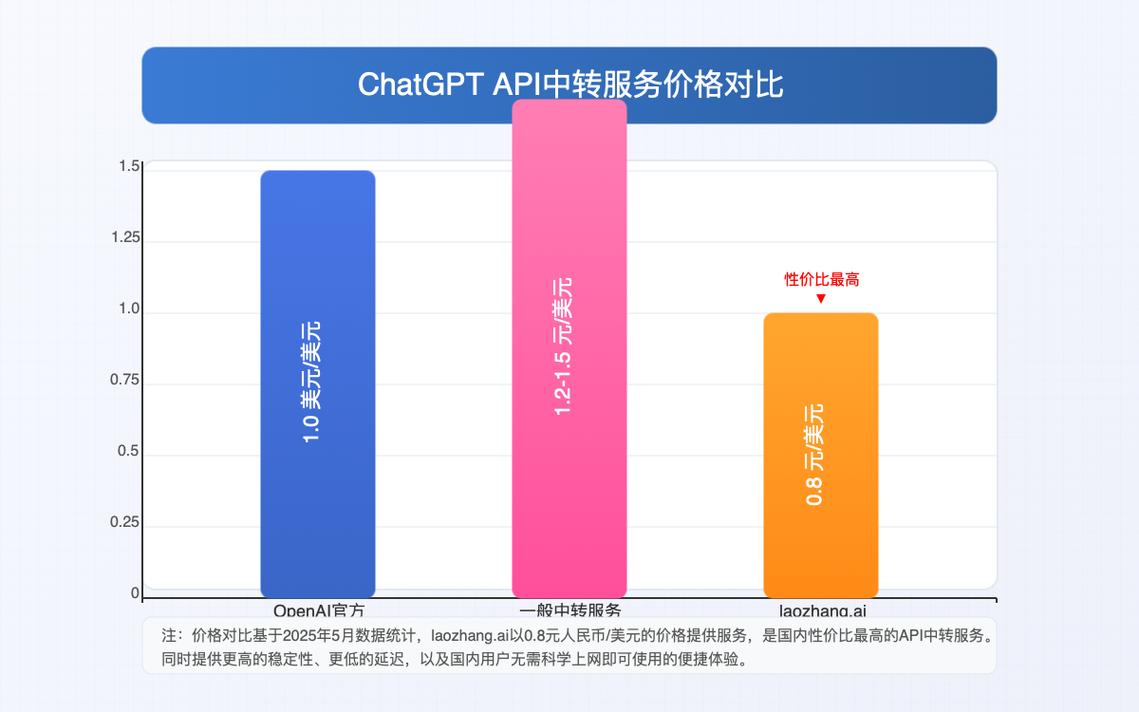

账单和成本——Token 用量猛涨,官方计费让不少企业叫苦,尤其是人民币结算、对账这些企业侧流程特别难落地。网络和稳定性——国内环境直连 OpenAI,偶尔延迟、断流,对业务影响极大。再强的模型,网不稳也白搭。灵活切换与备份——一旦模型故障或收紧权限,能不能秒切 Claude、Gemini 甚至国内大模型kimi api,直接关系到业务生死线。

所以,越来越多的团队明确了一个工程底线:不要绑死在唯一一个 API 入口,而要把“大模型算力”做成随时可切、像水电一样的可控资源池。

目前三种主流替代路线,各有利弊

1. 官方直连替换

比如直接用 Claude 4.6、Gemini 3.1 Pro、国内阿里/百度/字节的 API,手动一个个切换接口和认证。

优点:官方原汁原味。

痛点:每家接口格式不一样,要针对性改 SDK、处理上下游兼容,迁移成本不低。

2. 聚合平台网关

行业内越来越多人推荐的做法是:用 OpenAI 兼容的聚合平台做统一入口。

比如 147API 这类平台,已经悄悄在国内开发圈普及——直接兼容 OpenAI API 协议,大部分代码只改 base_url,模型参数随时切,底层用什么大模型都由平台托管。

最大优势:

3. 自建路由与网关

大厂或技术极强团队的选择:自己做 API 网关、路由调度器,后端接多个模型厂商。

好处:自主可控。

门槛:配套投入极高,从认证到模型切换、计费监控、网络优化都得自研,普通团队不推荐。

为什么聚合平台路线最“工程友好”?

拿目前行业用得较多的 147API 举例,它解决了几个原本让人头疼的工程难题:

实际怎么做?几步就能跑通

以聚合平台(比如 147API)为例,迁移流程其实很轻:

注册拿 Key:到平台官网注册,控制台获得 API Key 和 Base UR改配置:把你项目里原来的 OpenAI 配置里的 base_url 和 api_key 换成平台的,SDK 代码基本不用动。自测验通:先用一条简单请求验证链路通不通(比如发一个“你好”)Ollama 接口,通了再迁移业务流量。灰度主备切换:万一主力模型出问题,可以在平台后台一键切换备用模型(比如从 GPT-5.4 切到 Claude 4.6),业务侧完全无感。哪些行业已经在用?几个常见疑问

Q:聚合平台安全吗?会不会被平台绑定?

A:只要对接的是 OpenAI 兼容接口,随时可以导出 Key、切换主力模型,不存在平台锁死,工程透明度很高。

Q:性能和效果比官方差吗?

A:主流聚合平台已与大模型官方资源池深度合作价格最低 OpenAI api,响应速度和模型能力可对标开放api平台,且针对国内做了网络加速,大量企业已在生产环境验证过。

Q:数据隐私和合规呢?

A:不少平台支持专有通道、本地限流价格最低 OpenAI api,甚至支持企业自带密钥,有审计与合规配套,可根据业务需要灵活配置。

结语

2026 年,不管大模型行业怎么变,工程人的核心诉求始终是:稳定可靠 和 弹性切换。如果你还在为“只能用 OpenAI,怕挂了跑路难”而焦虑,不妨试试统一入口的思路——把所有的“模型焦虑”变成“像运维数据库一样的基础设施”,谁便宜、谁能用、谁跟得上场景,随时一键切换,让 AI 真正为业务所用,而不是被它绑架。

相关文章